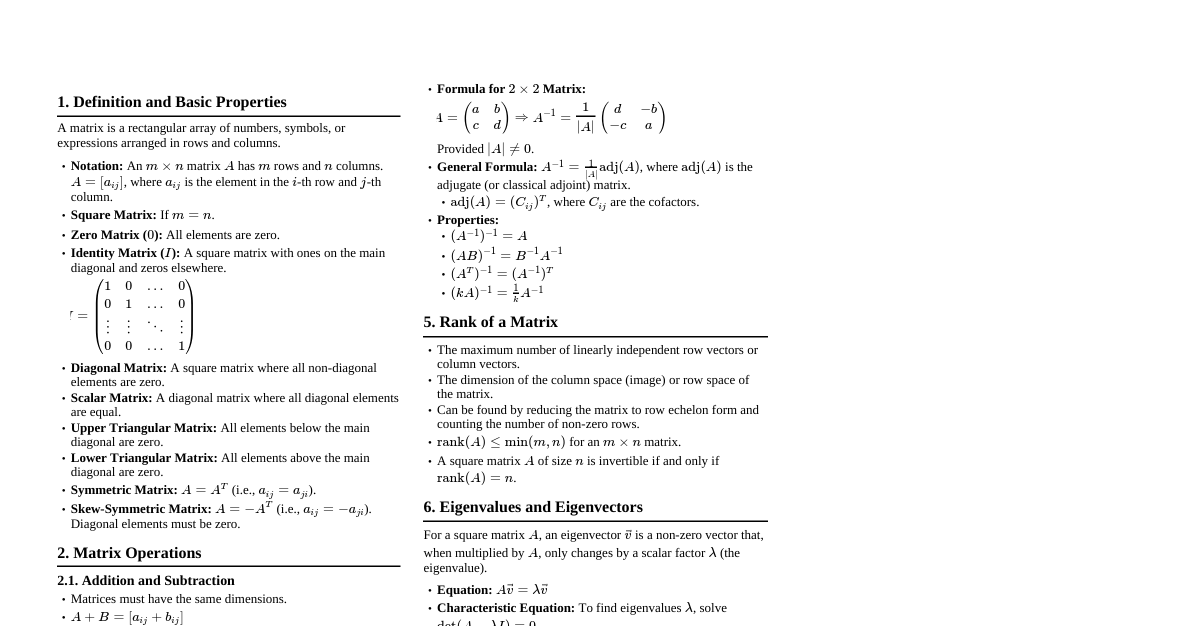

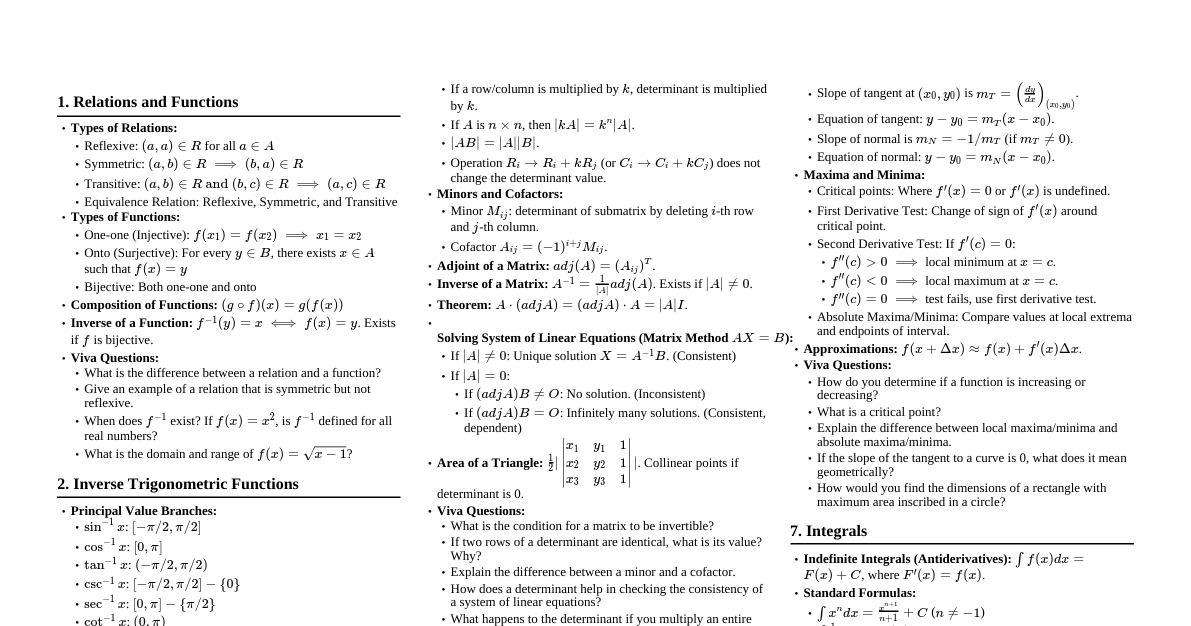

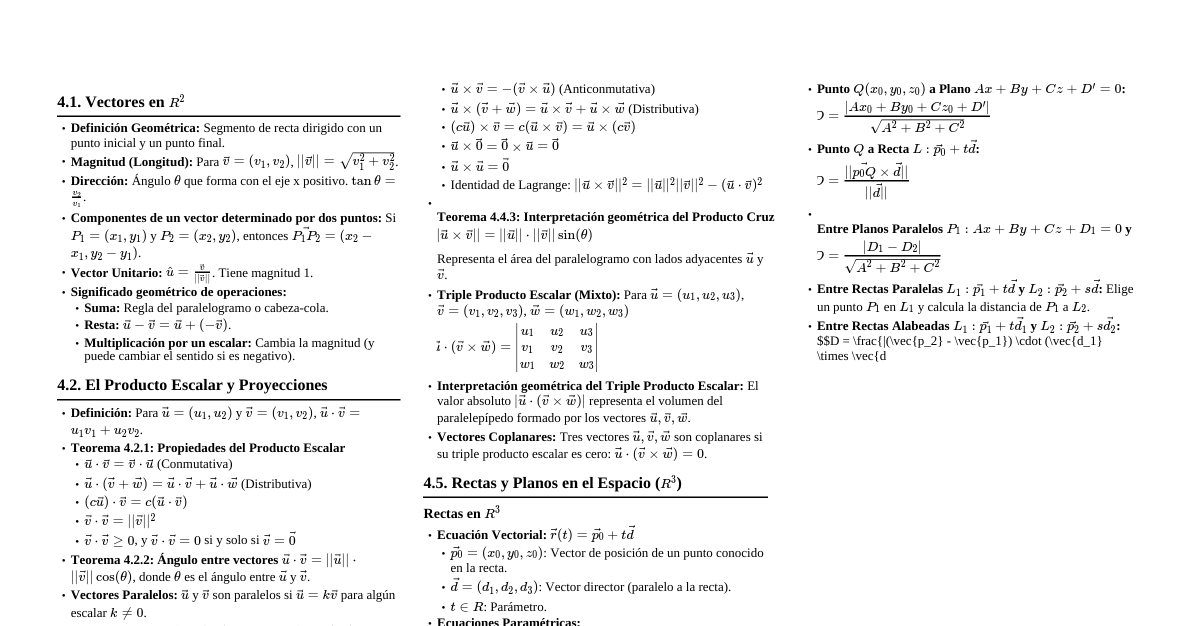

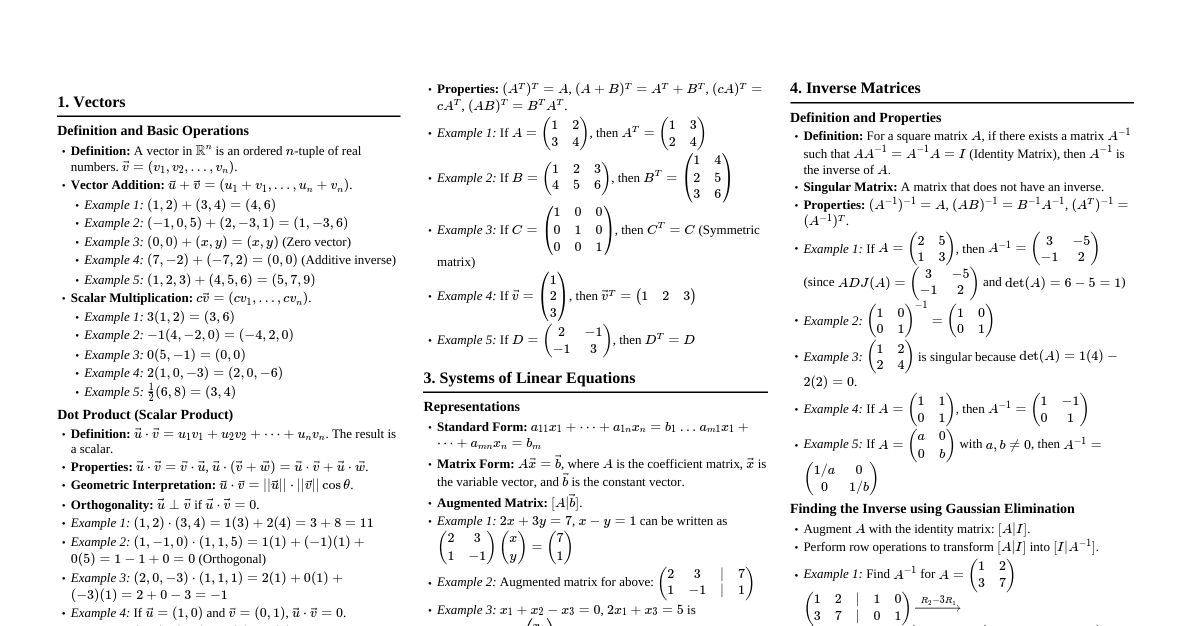

### Vectores Un vector es una cantidad que tiene magnitud y dirección. Puede ser representado como una flecha en el espacio. #### Representación - **Componentes:** $\vec{v} = (v_1, v_2, ..., v_n)$ o en notación de columna $\begin{pmatrix} v_1 \\ v_2 \\ \vdots \\ v_n \end{pmatrix}$ - **Base canónica:** $\vec{v} = v_1\hat{i} + v_2\hat{j} + v_3\hat{k}$ (para 3D) #### Operaciones Básicas - **Suma de vectores:** $\vec{a} + \vec{b} = (a_1+b_1, a_2+b_2, ..., a_n+b_n)$ - **Resta de vectores:** $\vec{a} - \vec{b} = (a_1-b_1, a_2-b_2, ..., a_n-b_n)$ - **Multiplicación por un escalar:** $c\vec{v} = (cv_1, cv_2, ..., cv_n)$ #### Magnitud y Dirección - **Magnitud (norma):** $|\vec{v}| = ||\vec{v}|| = \sqrt{v_1^2 + v_2^2 + ... + v_n^2}$ - **Vector unitario:** $\hat{u}_{\vec{v}} = \frac{\vec{v}}{||\vec{v}||}$ (vector con magnitud 1 en la dirección de $\vec{v}$) #### Productos de Vectores - **Producto punto (escalar):** - $\vec{a} \cdot \vec{b} = a_1b_1 + a_2b_2 + ... + a_nb_n$ - $\vec{a} \cdot \vec{b} = ||\vec{a}|| ||\vec{b}|| \cos\theta$, donde $\theta$ es el ángulo entre los vectores. - Si $\vec{a} \cdot \vec{b} = 0$, los vectores son ortogonales (perpendiculares). - **Producto cruz (vectorial, solo en 3D):** - $\vec{a} \times \vec{b} = \begin{vmatrix} \hat{i} & \hat{j} & \hat{k} \\ a_1 & a_2 & a_3 \\ b_1 & b_2 & b_3 \end{vmatrix} = (a_2b_3 - a_3b_2)\hat{i} - (a_1b_3 - a_3b_1)\hat{j} + (a_1b_2 - a_2b_1)\hat{k}$ - $||\vec{a} \times \vec{b}|| = ||\vec{a}|| ||\vec{b}|| \sin\theta$ (área del paralelogramo formado por $\vec{a}$ y $\vec{b}$) - $\vec{a} \times \vec{b}$ es ortogonal tanto a $\vec{a}$ como a $\vec{b}$. ### Matrices Una matriz es un arreglo rectangular de números, símbolos o expresiones. #### Representación - **Tamaño:** Una matriz $m \times n$ tiene $m$ filas y $n$ columnas. - **Elemento:** $A_{ij}$ denota el elemento en la fila $i$ y la columna $j$. #### Tipos Especiales de Matrices - **Matriz cuadrada:** $m=n$. - **Matriz identidad ($I$):** Matriz cuadrada con unos en la diagonal principal y ceros en el resto. $AI = IA = A$. - **Matriz nula ($0$):** Todos sus elementos son cero. - **Matriz diagonal:** Solo tiene elementos distintos de cero en la diagonal principal. - **Matriz triangular superior/inferior:** Todos los elementos por debajo/encima de la diagonal principal son cero. - **Matriz simétrica:** $A^T = A$. - **Matriz antisimétrica:** $A^T = -A$. #### Operaciones con Matrices - **Suma/Resta:** Solo para matrices del mismo tamaño. Se suman/restan elemento a elemento. - $(A+B)_{ij} = A_{ij} + B_{ij}$ - **Multiplicación por un escalar:** $cA$ multiplica cada elemento de $A$ por $c$. - $(cA)_{ij} = cA_{ij}$ - **Multiplicación de matrices ($AB$):** - Solo si el número de columnas de $A$ es igual al número de filas de $B$. - Si $A$ es $m \times p$ y $B$ es $p \times n$, entonces $AB$ es $m \times n$. - $(AB)_{ij} = \sum_{k=1}^{p} A_{ik}B_{kj}$ - La multiplicación de matrices NO es conmutativa ($AB \neq BA$ en general). - **Traspuesta ($A^T$):** Intercambia filas por columnas. - $(A^T)_{ij} = A_{ji}$ - Propiedades: $(A^T)^T = A$, $(A+B)^T = A^T+B^T$, $(cA)^T = cA^T$, $(AB)^T = B^TA^T$. #### Determinante de una Matriz (solo para matrices cuadradas) - **$2 \times 2$:** $\det\begin{pmatrix} a & b \\ c & d \end{pmatrix} = ad - bc$ - **$3 \times 3$ (Regla de Sarrus o cofactores):** - $\det(A) = a(ei-fh) - b(di-fg) + c(dh-eg)$ - **Propiedades:** - $\det(A^T) = \det(A)$ - $\det(AB) = \det(A)\det(B)$ - $\det(cA) = c^n \det(A)$ (para una matriz $n \times n$) - $\det(A) = 0$ si las filas/columnas son linealmente dependientes (matriz singular). #### Inversa de una Matriz ($A^{-1}$) - Solo existe si $A$ es una matriz cuadrada y $\det(A) \neq 0$ (matriz no singular). - $AA^{-1} = A^{-1}A = I$ - **$2 \times 2$:** $A^{-1} = \frac{1}{\det(A)}\begin{pmatrix} d & -b \\ -c & a \end{pmatrix}$ - **Método general:** $A^{-1} = \frac{1}{\det(A)} \text{adj}(A)$, donde $\text{adj}(A)$ es la traspuesta de la matriz de cofactores. - **Propiedades:** $(A^{-1})^{-1}=A$, $(AB)^{-1}=B^{-1}A^{-1}$, $(A^T)^{-1}=(A^{-1})^T$. #### Rango de una Matriz - El número máximo de filas (o columnas) linealmente independientes. - Para una matriz $A$ de $m \times n$, $\text{rango}(A) \le \min(m, n)$. - $\text{rango}(A) = n$ si y solo si $\det(A) \neq 0$ (para matrices cuadradas $n \times n$). #### Sistemas de Ecuaciones Lineales - Representación matricial: $A\vec{x} = \vec{b}$ - $A$: matriz de coeficientes - $\vec{x}$: vector de incógnitas - $\vec{b}$: vector de términos constantes - **Solución única:** Si $A$ es cuadrada y $\det(A) \neq 0$, entonces $\vec{x} = A^{-1}\vec{b}$. - **Métodos de solución:** Eliminación Gaussiana, Regla de Cramer. ### Valores y Vectores Propios (Eigenvalores y Eigenvectores) Conceptos fundamentales en el estudio de transformaciones lineales. #### Definición - Para una matriz cuadrada $A$, un vector no nulo $\vec{v}$ es un **vector propio** de $A$ si $A\vec{v} = \lambda\vec{v}$, donde $\lambda$ es un escalar llamado **valor propio**. - El vector $\vec{v}$ solo cambia de escala por la transformación de $A$, pero no de dirección. #### Cálculo 1. **Ecuación característica:** Para encontrar los valores propios $\lambda$, resolvemos la ecuación $\det(A - \lambda I) = 0$. - $I$ es la matriz identidad del mismo tamaño que $A$. - Esto da un polinomio característico cuyas raíces son los valores propios. 2. **Cálculo de vectores propios:** Para cada valor propio $\lambda_i$ encontrado, resolvemos el sistema lineal $(A - \lambda_i I)\vec{v} = \vec{0}$ para encontrar los vectores propios asociados. #### Propiedades - La suma de los valores propios es igual a la traza de la matriz ($\text{tr}(A) = \sum A_{ii}$). - El producto de los valores propios es igual al determinante de la matriz ($\det(A)$). - Si $A$ es simétrica, sus valores propios son reales y sus vectores propios correspondientes a valores propios distintos son ortogonales. #### Diagonalización - Una matriz $A$ es diagonalizable si existe una matriz invertible $P$ tal que $D = P^{-1}AP$ es una matriz diagonal. - Las columnas de $P$ son los vectores propios de $A$. - Los elementos de la diagonal de $D$ son los valores propios de $A$. - Una matriz es diagonalizable si tiene $n$ vectores propios linealmente independientes (donde $n$ es la dimensión de la matriz).