Formulario de Probabilidad

Cheatsheet Content

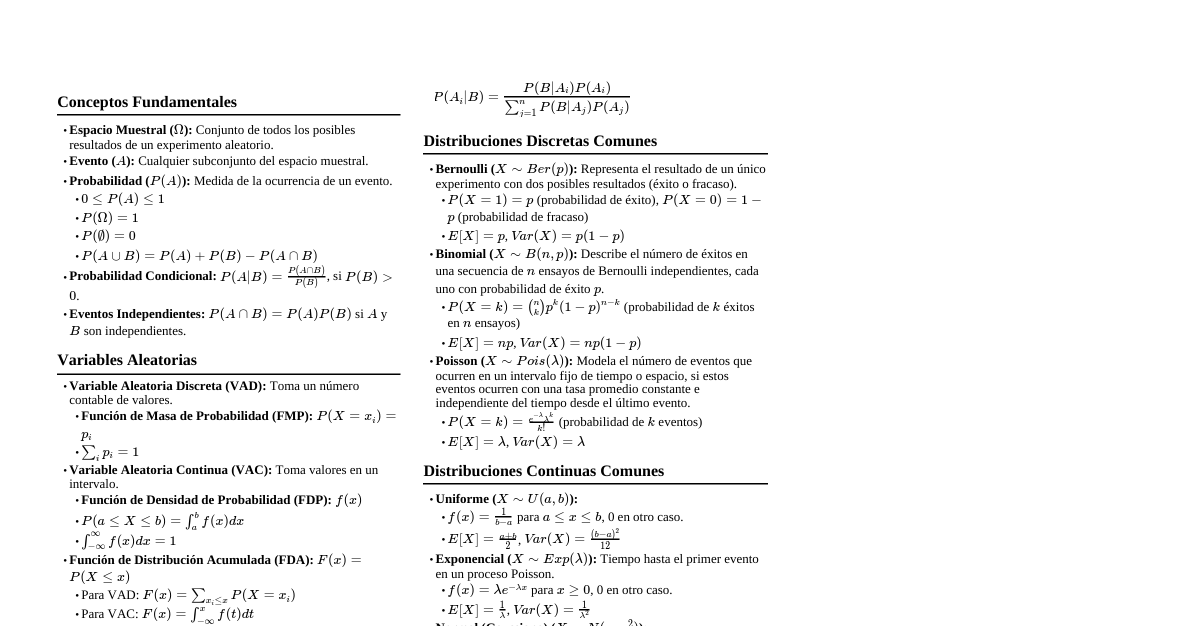

### Conceptos Básicos - **Experimento Aleatorio:** Proceso cuyo resultado no se puede predecir con certeza. - **Espacio Muestral ($\Omega$ o $S$):** Conjunto de todos los posibles resultados de un experimento aleatorio. - Ej: Lanzar un dado: $\Omega = \{1, 2, 3, 4, 5, 6\}$ - **Evento (A, B, ...):** Cualquier subconjunto del espacio muestral. - Ej: Obtener un número par al lanzar un dado: $A = \{2, 4, 6\}$ - **Probabilidad de un Evento (P(A)):** Medida de la posibilidad de que ocurra un evento. - $0 \le P(A) \le 1$ - $P(\Omega) = 1$ (Probabilidad del evento seguro) - $P(\emptyset) = 0$ (Probabilidad del evento imposible) ### Reglas Fundamentales de Probabilidad #### 1. Regla de Laplace Si todos los resultados posibles son igualmente probables: $$P(A) = \frac{\text{Número de casos favorables a A}}{\text{Número total de casos posibles}}$$ #### 2. Unión de Eventos - **Para dos eventos A y B:** $P(A \cup B) = P(A) + P(B) - P(A \cap B)$ - **Si A y B son mutuamente excluyentes (disjuntos, $A \cap B = \emptyset$):** $P(A \cup B) = P(A) + P(B)$ #### 3. Intersección de Eventos (Probabilidad Conjunta) - **Para dos eventos A y B:** $P(A \cap B) = P(A|B)P(B) = P(B|A)P(A)$ - **Si A y B son independientes ($P(A|B) = P(A)$ y $P(B|A) = P(B)$):** $P(A \cap B) = P(A)P(B)$ #### 4. Evento Complementario - El complemento de A, $A^c$ o $\bar{A}$, es el evento de que A no ocurra. $P(A^c) = 1 - P(A)$ #### 5. Probabilidad Condicional - La probabilidad de que ocurra el evento A dado que el evento B ya ocurrió: $$P(A|B) = \frac{P(A \cap B)}{P(B)}, \quad \text{si } P(B) > 0$$ #### 6. Teorema de la Probabilidad Total Si $B_1, B_2, ..., B_n$ es una partición del espacio muestral (eventos mutuamente excluyentes y su unión es $\Omega$): $$P(A) = \sum_{i=1}^{n} P(A|B_i)P(B_i)$$ #### 7. Teorema de Bayes $$P(B_k|A) = \frac{P(A|B_k)P(B_k)}{\sum_{i=1}^{n} P(A|B_i)P(B_i)}$$ ### Variables Aleatorias #### 1. Variable Aleatoria Discreta (X) - Toma un número contable de valores. - **Función de Masa de Probabilidad (FMP), $P(X=x_i)$:** - $P(X=x_i) \ge 0$ - $\sum_i P(X=x_i) = 1$ - **Valor Esperado (Media):** $E[X] = \sum_i x_i P(X=x_i)$ - **Varianza:** $Var(X) = E[(X - E[X])^2] = E[X^2] - (E[X])^2$ #### 2. Variable Aleatoria Continua (X) - Toma cualquier valor en un intervalo. - **Función de Densidad de Probabilidad (FDP), $f(x)$:** - $f(x) \ge 0$ - $\int_{-\infty}^{\infty} f(x) dx = 1$ - $P(a \le X \le b) = \int_a^b f(x) dx$ - **Valor Esperado (Media):** $E[X] = \int_{-\infty}^{\infty} x f(x) dx$ - **Varianza:** $Var(X) = \int_{-\infty}^{\infty} (x - E[X])^2 f(x) dx = E[X^2] - (E[X])^2$ #### 3. Función de Distribución Acumulada (FDA), $F(x)$ - Para variables discretas: $F(x) = P(X \le x) = \sum_{x_i \le x} P(X=x_i)$ - Para variables continuas: $F(x) = P(X \le x) = \int_{-\infty}^x f(t) dt$ - Propiedades: - $0 \le F(x) \le 1$ - $F(x)$ es no decreciente - $\lim_{x \to -\infty} F(x) = 0$, $\lim_{x \to \infty} F(x) = 1$ - $P(a < X \le b) = F(b) - F(a)$ - Si X es continua, $f(x) = \frac{d}{dx} F(x)$ ### Distribuciones de Probabilidad Comunes #### 1. Discretas - **Bernoulli ($p$):** $P(X=1)=p$, $P(X=0)=1-p$. $E[X]=p$, $Var(X)=p(1-p)$. - **Binomial ($n, p$):** Número de éxitos en $n$ ensayos Bernoulli independientes. $P(X=k) = \binom{n}{k} p^k (1-p)^{n-k}$. $E[X]=np$, $Var(X)=np(1-p)$. - **Poisson ($\lambda$):** Número de eventos en un intervalo fijo. $P(X=k) = \frac{e^{-\lambda} \lambda^k}{k!}$. $E[X]=\lambda$, $Var(X)=\lambda$. #### 2. Continuas - **Uniforme ($a, b$):** Cada valor en $[a, b]$ es igualmente probable. $f(x) = \frac{1}{b-a}$ para $a \le x \le b$, y $0$ en otro caso. $E[X]=\frac{a+b}{2}$, $Var(X)=\frac{(b-a)^2}{12}$. - **Exponencial ($\lambda$):** Tiempo hasta el primer evento en un proceso de Poisson. $f(x) = \lambda e^{-\lambda x}$ para $x \ge 0$, y $0$ en otro caso. $E[X]=\frac{1}{\lambda}$, $Var(X)=\frac{1}{\lambda^2}$. - **Normal ($\mu, \sigma^2$):** Distribución en forma de campana. $f(x) = \frac{1}{\sigma \sqrt{2\pi}} e^{-\frac{1}{2}\left(\frac{x-\mu}{\sigma}\right)^2}$. $E[X]=\mu$, $Var(X)=\sigma^2$. - **Normal Estándar (Z):** $\mu=0, \sigma^2=1$. $Z = \frac{X-\mu}{\sigma}$. ### Desigualdad de Chebyshev Para cualquier variable aleatoria X con media $\mu$ y varianza finita $\sigma^2$: $$P(|X - \mu| \ge k\sigma) \le \frac{1}{k^2}$$ o equivalentemente $$P(|X - \mu| < k\sigma) \ge 1 - \frac{1}{k^2}$$