Probabilidad y Estadística

Cheatsheet Content

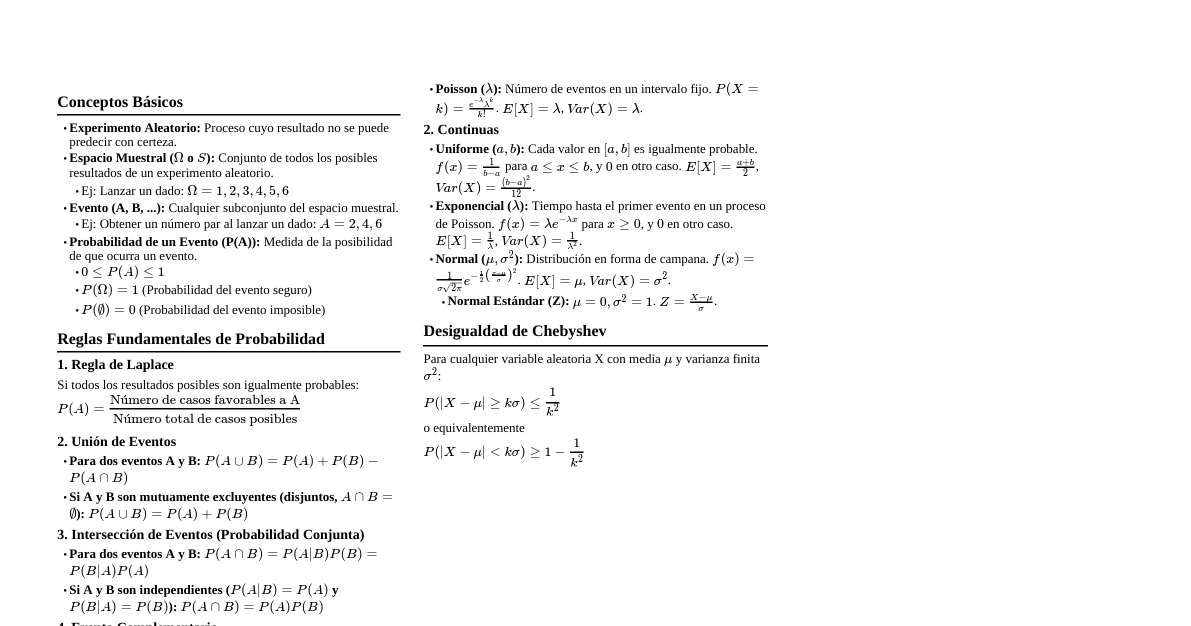

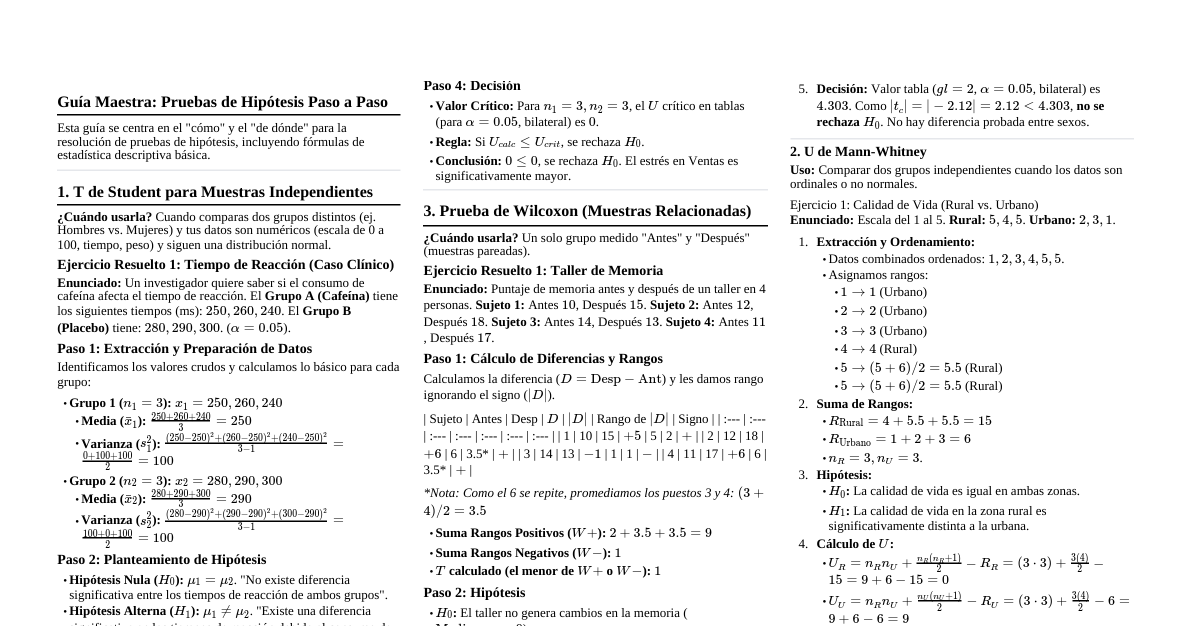

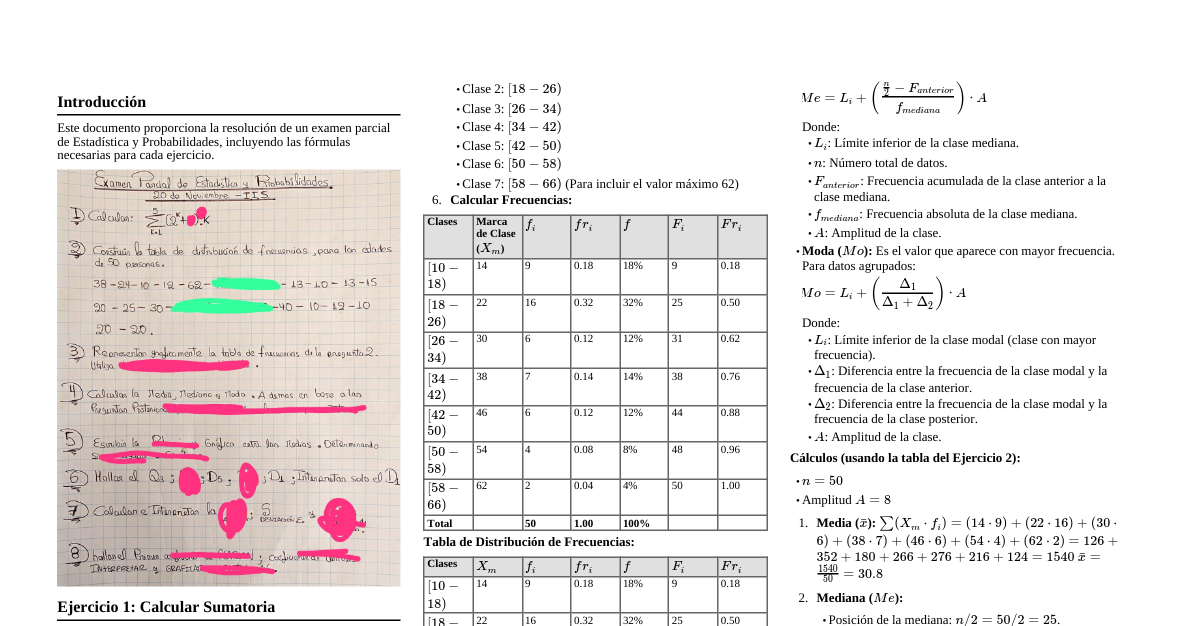

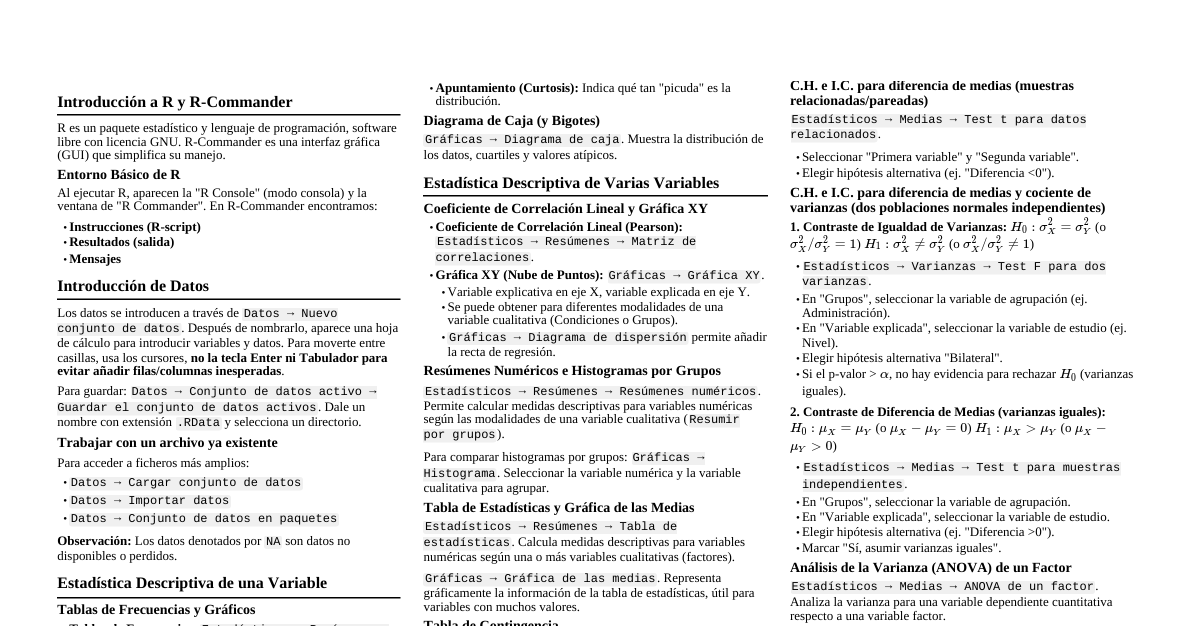

### Conceptos Fundamentales - **Espacio Muestral ($\Omega$):** Conjunto de todos los posibles resultados de un experimento aleatorio. - **Evento ($A$):** Cualquier subconjunto del espacio muestral. - **Probabilidad ($P(A)$):** Medida de la ocurrencia de un evento. - $0 \le P(A) \le 1$ - $P(\Omega) = 1$ - $P(\emptyset) = 0$ - $P(A \cup B) = P(A) + P(B) - P(A \cap B)$ - **Probabilidad Condicional:** $P(A|B) = \frac{P(A \cap B)}{P(B)}$, si $P(B) > 0$. - **Eventos Independientes:** $P(A \cap B) = P(A)P(B)$ si $A$ y $B$ son independientes. ### Variables Aleatorias - **Variable Aleatoria Discreta (VAD):** Toma un número contable de valores. - **Función de Masa de Probabilidad (FMP):** $P(X=x_i) = p_i$ - $\sum_i p_i = 1$ - **Variable Aleatoria Continua (VAC):** Toma valores en un intervalo. - **Función de Densidad de Probabilidad (FDP):** $f(x)$ - $P(a \le X \le b) = \int_a^b f(x) dx$ - $\int_{-\infty}^{\infty} f(x) dx = 1$ - **Función de Distribución Acumulada (FDA):** $F(x) = P(X \le x)$ - Para VAD: $F(x) = \sum_{x_i \le x} P(X=x_i)$ - Para VAC: $F(x) = \int_{-\infty}^{x} f(t) dt$ ### Esperanza y Varianza - **Esperanza (Valor Esperado) $E[X]$:** - VAD: $E[X] = \sum_i x_i P(X=x_i)$ - VAC: $E[X] = \int_{-\infty}^{\infty} x f(x) dx$ - **Propiedades:** - $E[c] = c$ - $E[aX + b] = aE[X] + b$ - $E[X+Y] = E[X] + E[Y]$ - **Varianza $Var(X)$:** Medida de dispersión. - $Var(X) = E[(X - E[X])^2] = E[X^2] - (E[X])^2$ - **Propiedades:** - $Var(c) = 0$ - $Var(aX + b) = a^2Var(X)$ - $Var(X+Y) = Var(X) + Var(Y) + 2Cov(X,Y)$ - Si $X, Y$ son independientes: $Var(X+Y) = Var(X) + Var(Y)$ - **Desviación Estándar ($\sigma_X$):** $\sigma_X = \sqrt{Var(X)}$ ### Covarianza y Correlación - **Covarianza $Cov(X,Y)$:** Medida de la relación lineal entre dos variables. - $Cov(X,Y) = E[(X - E[X])(Y - E[Y])] = E[XY] - E[X]E[Y]$ - **Propiedades:** - $Cov(X,X) = Var(X)$ - $Cov(X,Y) = Cov(Y,X)$ - $Cov(aX+b, cY+d) = acCov(X,Y)$ - Si $X, Y$ son independientes, $Cov(X,Y) = 0$. (Lo contrario no siempre es cierto) - **Coeficiente de Correlación de Pearson ($\rho_{X,Y}$):** - $\rho_{X,Y} = \frac{Cov(X,Y)}{\sigma_X \sigma_Y}$ - $-1 \le \rho_{X,Y} \le 1$ - $\rho_{X,Y} = 0$ implica no correlación lineal. - $\rho_{X,Y} = 1$ o $-1$ implica una perfecta relación lineal. ### Bias - **Bias de un Estimador ($\hat{\theta}$):** - $Bias(\hat{\theta}) = E[\hat{\theta}] - \theta$ - Un estimador es insesgado si $Bias(\hat{\theta}) = 0$, es decir, $E[\hat{\theta}] = \theta$. ### Teorema de Bayes - **Fórmula:** $$ P(A|B) = \frac{P(B|A)P(A)}{P(B)} $$ Donde: - $P(A|B)$ es la probabilidad posterior (probabilidad de $A$ dado $B$). - $P(B|A)$ es la verosimilitud (probabilidad de $B$ dado $A$). - $P(A)$ es la probabilidad previa (probabilidad inicial de $A$). - $P(B)$ es la evidencia (probabilidad marginal de $B$). - **Para eventos mutuamente excluyentes y exhaustivos ($A_1, A_2, ..., A_n$):** $$ P(A_i|B) = \frac{P(B|A_i)P(A_i)}{\sum_{j=1}^n P(B|A_j)P(A_j)} $$ ### Distribuciones Discretas Comunes - **Bernoulli ($X \sim Ber(p)$):** Representa el resultado de un único experimento con dos posibles resultados (éxito o fracaso). - $P(X=1) = p$ (probabilidad de éxito), $P(X=0) = 1-p$ (probabilidad de fracaso) - $E[X] = p$, $Var(X) = p(1-p)$ - **Binomial ($X \sim B(n, p)$):** Describe el número de éxitos en una secuencia de $n$ ensayos de Bernoulli independientes, cada uno con probabilidad de éxito $p$. - $P(X=k) = \binom{n}{k} p^k (1-p)^{n-k}$ (probabilidad de $k$ éxitos en $n$ ensayos) - $E[X] = np$, $Var(X) = np(1-p)$ - **Poisson ($X \sim Pois(\lambda)$):** Modela el número de eventos que ocurren en un intervalo fijo de tiempo o espacio, si estos eventos ocurren con una tasa promedio constante e independiente del tiempo desde el último evento. - $P(X=k) = \frac{e^{-\lambda} \lambda^k}{k!}$ (probabilidad de $k$ eventos) - $E[X] = \lambda$, $Var(X) = \lambda$ ### Distribuciones Continuas Comunes - **Uniforme ($X \sim U(a, b)$):** - $f(x) = \frac{1}{b-a}$ para $a \le x \le b$, 0 en otro caso. - $E[X] = \frac{a+b}{2}$, $Var(X) = \frac{(b-a)^2}{12}$ - **Exponencial ($X \sim Exp(\lambda)$):** Tiempo hasta el primer evento en un proceso Poisson. - $f(x) = \lambda e^{-\lambda x}$ para $x \ge 0$, 0 en otro caso. - $E[X] = \frac{1}{\lambda}$, $Var(X) = \frac{1}{\lambda^2}$ - **Normal (Gaussiana) ($X \sim N(\mu, \sigma^2)$):** - $f(x) = \frac{1}{\sigma\sqrt{2\pi}} e^{-\frac{1}{2}(\frac{x-\mu}{\sigma})^2}$ - $E[X] = \mu$, $Var(X) = \sigma^2$ - **Normal Estándar ($Z \sim N(0, 1)$):** $Z = \frac{X-\mu}{\sigma}$